Schulung: Effizientes Lernen mit LLMs

Im Folgenden werden Sie eine Schulung zum effizienten Lernen mit Large Language Models (LLMs) absolvieren. Dabei werden Sie zunächst in die Funktionsweise von LLMs eingeführt und anschliessend darin angeleitet, wie Sie diese so nutzen können, dass Sie damit mehr – und nicht weniger – lernen. Die Schulung gliedert sich in drei Teile: Grundlagen der KI und LLMs, Prompt Engineering und Effizient Lernen mit LLMs.

Am Ende haben Sie die Möglichkeit, weiterführende Materialien zu allen drei Teilen zu finden, falls Sie die Inhalte der Schulung später noch einmal vertiefen möchten.

Teil 1: Grundlagen der KI und LLMs

Lernziele für diesen Teil:

- Wissen, was LLMs sind und wie sie funktionieren

- Wissen, was die Limitationen von KI und LLMs sind

Die hier vorgestellten Informationen bieten einen kurzen Einstieg in das umfassende und sich rasant entwickelnde Feld der künstlichen Intelligenz (KI). Schon heutige KI-Systeme erbringen beeindruckende Leistungen. Angesichts der rasanten technologischen Entwicklung ist jedoch davon auszugehen, dass zukünftige Systeme deutlich leistungsfähiger und vielseitiger sein werden. Daher ist es ziemlich wahrscheinlich, dass die aktuelle KI die „am wenigsten leistungsfähige" ist, die wir je erleben werden.

Was sind LLMs?

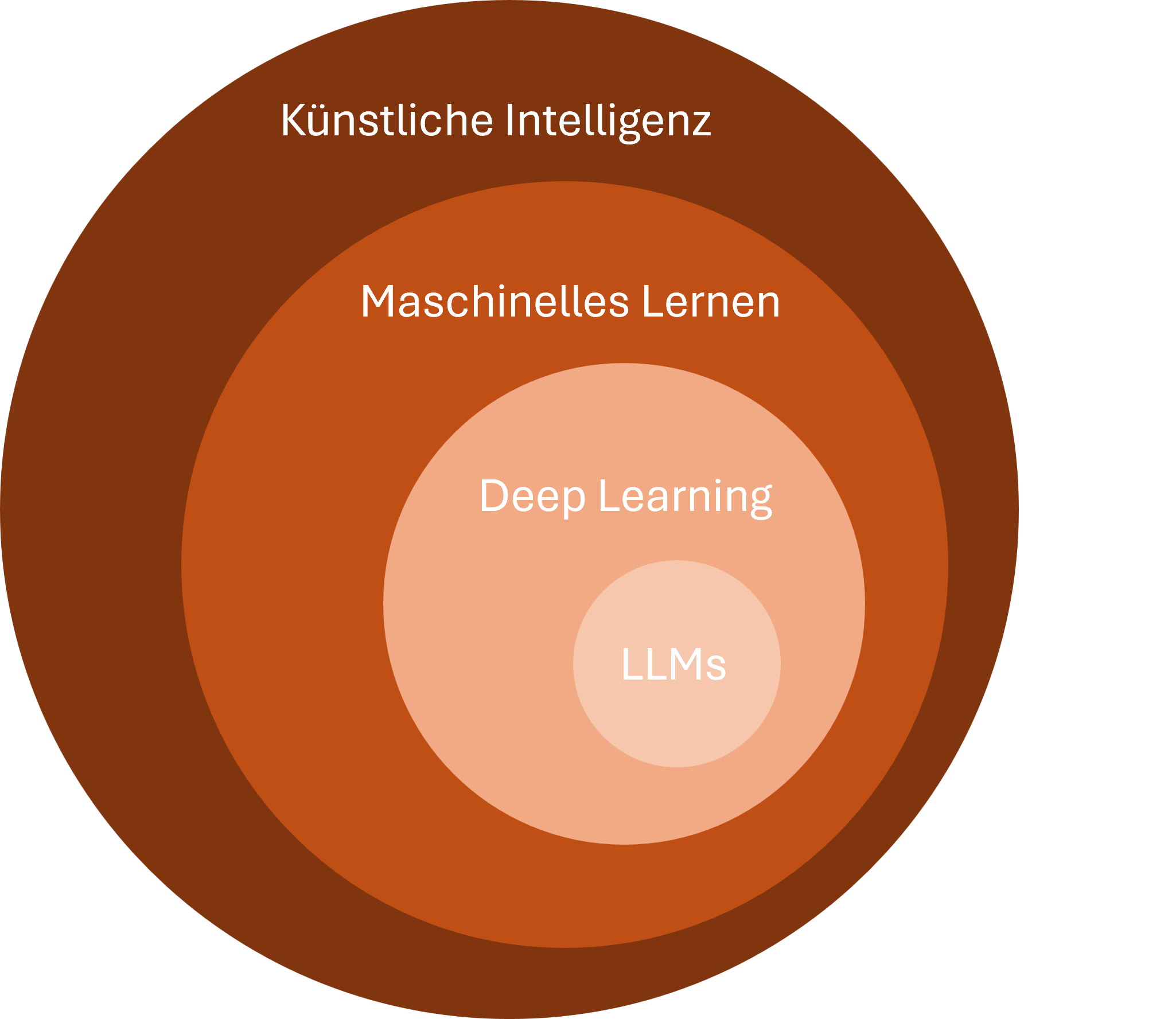

LLMs sind KI-Modelle, welche mit riesigen Mengen an Text trainiert wurden, um Sprache zu verarbeiten und zu erzeugen. Um besser zu verstehen, wie LLMs einzuordnen sind, hilft es, sich die KI als ein System mit mehreren Ebenen vorzustellen:

Abbildung 1: Künstliche Intelligenz in Schichten

Anmerkung: Adaptiert aus How large language models work, von A. Stöffelbauer, 2023.

Ganz oben steht die KI. Dieser Begriff bezeichnet Systeme oder Maschinen, die Aufgaben ausführen, für die normalerweise menschliche Intelligenz erforderlich ist – zum Beispiel Lernen, Problemlösen, Sprachverstehen oder Entscheidungsfindung.

Eine Ebene darunter liegt das maschinelle Lernen (ML). ML ist ein Teilgebiet der KI, bei dem Systeme lernen, Muster und Zusammenhänge in Daten zu erkennen. Auf dieser Grundlage können sie neue, unbekannte Daten einordnen oder Vorhersagen treffen – ohne dafür explizit programmiert zu sein.

Ein Teilbereich des ML ist das Deep Learning. Dieser Bereich beschäftigt sich mit besonders komplexen Modellen, die mit sogenannten künstlichen neuronalen Netzen arbeiten. Diese Netze sind – stark vereinfacht – vom menschlichen Gehirn inspiriert und können mit unstrukturierten Daten wie Texten oder Bildern umgehen.

LLMs sind schliesslich eine spezielle Form von Deep Learning-Modellen. Sie wurden darauf trainiert, auf menschliche Sprache zu reagieren und diese zu erzeugen. Das „large" (deutsch: gross) im Namen bezieht sich auf die enorme Anzahl von Parametern (vergleichbar mit „Neuronen") in ihren Netzwerken. Ein bekanntes Beispiel für ein solches Modell ist GPT von OpenAI, das Modell, worauf ChatGPT basiert.

LLMs funktionieren grundsätzlich so: Basierend auf den riesigen Mengen an Textdaten, mit denen sie trainiert wurden, sagen sie das nächste Wort in einem Text vorher. Die Auswahl basiert auf Wahrscheinlichkeiten. Im Training haben sie „gelernt", wie Sprache aufgebaut ist, welche Wörter gut zusammenpassen und wie bestimmte Inhalte typischerweise formuliert werden. Die Abkürzung „GPT" in ChatGPT steht für Generative Pre-trained Transformer. Das bedeutet: Das Modell wurde zunächst auf eine Vielzahl von Texten vortrainiert („Pre-trained") und nutzt eine spezielle Architektur („Transformer"), die besonders gut darin ist, Muster in Texten zu erkennen.

Stöffelbauer, A. (2023, 24. Oktober). How large language models work: From zero to ChatGPT. Medium. Abgerufen am 12. Mai 2025, von https://medium.com/data-science-at-microsoft/how-large-language-models-work-91c362f5b78f.

Training von LLMs

Um die Funktionsweise und auch die Limitationen von LLMs besser zu verstehen, ist es wichtig nachzuvollziehen, wie LLMs trainiert werden. Das Training von LLMs verläuft in der Regel in drei aufeinanderfolgenden Phasen:

1. Vortraining (Pre-Training):

In dieser ersten Phase wird das Modell mit sehr grossen Mengen an Texten „gefüttert". Dabei lernt es, wie Sprache aufgebaut ist, welche Wörter häufig zusammen vorkommen und sammelt gleichzeitig ein breites Allgemeinwissen aus den Texten. Bei den Texten, die dem Modell zum Training zur Verfügung gestellt werden, handelt es sich meist um öffentlich zugängliche Daten. Das beinhaltet Texte von Webseiten, aus Büchern, Artikeln usw.

2. Finetuning auf Anweisungen (Instruction Fine-Tuning):

Nach dem Vortraining bekommt das Modell gezielt Beispiele dafür, wie es auf menschliche Anweisungen reagieren soll. Dazu nutzt man Datensätze, die aus vielen Paaren bestehen: jeweils eine Aufgabe oder Frage und eine gute, passende Antwort dazu. Das Modell wird nun so trainiert, dass es lernt, bei ähnlichen Eingaben ebenfalls passende und hilfreiche Antworten zu geben. Es passt sich also an die Art und Weise an, wie Menschen Anweisungen formulieren – und wie sie sinnvolle Antworten erwarten.

3. Verstärkendes Lernen mit menschlichem Feedback (RLHF – Reinforcement Learning from Human Feedback):

In dieser optionalen dritten Phase geben Menschen dem Modell Rückmeldungen dazu, welche Antworten besonders hilfreich, klar oder angemessen sind. Das Modell lernt daraus, sich stärker an menschlichen Erwartungen und Werten zu orientieren.

Limitationen von LLMs

LLMs erzeugen keine „echten" Gedanken oder Fakten. Sie arbeiten rein auf der Basis von Wahrscheinlichkeiten und Mustern, die sie aus ihren Trainingsdaten gelernt haben. Das hat einige wichtige Konsequenzen:

Halluzinationen. LLMs wissen nicht, ob etwas wahr ist. Wie ein Papagei plappern sie aus, was sie aus den Daten gelernt haben. Dabei können Fehler entstehen, wenn falsche Informationen in den Daten stecken, die das Modell übernimmt, oder wenn bestimmte Inhalte fehlen und das Modell basierend auf ähnlichen Mustern eine Antwort „erfindet". In beiden Fällen können Aussagen entstehen, die zwar plausibel klingen, aber inhaltlich falsch oder frei erfunden sind. Solche Fehler werden als Halluzinationen bezeichnet.

Nicht deterministisch. LLMs sind meistens so eingestellt, dass sie nicht deterministisch sind. Das bedeutet, dass dieselbe Anfrage unterschiedliche Antworten liefern kann.

Inkonsequente Befolgung von Anweisungen. Wir können uns nie ganz sicher sein, dass LLMs sich genau an unsere Anweisungen halten. Es kann sein, dass sie Teile davon nicht oder anders umsetzen.

Verzerrte Antworten. Die Modelle wurden so trainiert, dass sie bevorzugt „gute" Antworten geben. „Gute" Antworten sind solche, die überzeugend wirken. Das ist unter anderem auf das Reinforcement Learning from Human Feedback zurückzuführen. Antworten, die flüssig klingen, werden dabei häufig als besser beurteilt – auch wenn sie inhaltlich falsch sind. Das verstärkt die Tendenz von LLMs, fehlende Informationen durch erfundene Inhalte zu ersetzen, statt anzugeben, dass nicht ausreichend Information vorliegt.

Wissensstand der KIs. LLMs haben nur Zugriff auf Informationen bis zu dem Zeitpunkt, an dem sie trainiert wurden. Über alles, was danach passiert ist, verfügen sie über keine Kenntnisse – es sei denn, sie haben direkten Zugang zum Internet. Deshalb können sie zu aktuellen Ereignissen oft keine verlässlichen Aussagen machen, da solche Informationen nicht Teil ihrer Trainingsdaten sind.

Verzerrungen in Trainingsdaten. Texte im Internet oder in Büchern enthalten manchmal Fehler, veraltete Informationen oder einseitige Sichtweisen. Auch Diskriminierung und stereotype Darstellungen können darin enthalten sein. Diese Einstellungen werden vom Modell unter Umständen übernommen, was zu verzerrten Aussagen führen kann.

Fehlende Quellenangaben. LLMs wie GPT nennen in ihren Antworten meist keine oder ungenaue Quellen. Zudem kann es vorkommen, dass LLMs wissenschaftliche Quellen erfinden und so beispielsweise Paper zitieren, die nicht existieren. Das erschwert die Überprüfung der Inhalte.

Fazit: Es ist wichtig, dass Sie als Lernende die Grenzen von LLM-generierten Inhalten kennen und diese immer kritisch hinterfragen. Verlassen Sie sich nicht blind auf die Richtigkeit der generierten Texte. Prüfen Sie die Inhalte auf Plausibilität und suchen Sie im Zweifelsfall immer nach verlässlichen Quellen. Nur so können Sie sicherstellen, dass Sie nicht falsche oder verzerrte Informationen übernehmen.

Die wichtigsten Punkte aus diesem Teil:

- LLMs sind keine Wahrheitsgeneratoren. Sie erzeugen wahrscheinliche Wortfolgen, die sprachlich plausibel klingen, aber nicht automatisch wahr sind.

- Die Aussagen von LLMs müssen kritisch betrachtet und überprüft werden.

Teil 2: Prompt Engineering

Lernziel für diesen Teil:

- Die grundlegenden Aspekte des Prompt Engineerings kennen

Was ist Prompt Engineering? Prompt Engineering ist die Wissenschaft, KI-Systeme präzise und strategisch zu steuern, um optimale Ergebnisse zu erzielen. Es geht darum, durch gezielte und gut formulierte Eingaben (Prompts) die gewünschten Outputs von KI-Modellen zu erhalten. Je klarer und präziser ein Prompt formuliert ist, desto höher ist die Wahrscheinlichkeit, eine passende und hilfreiche Antwort zu erhalten, die dem eigenen Bedürfnis entspricht. Gute Prompts enthalten unter anderem relevante Hintergrundinformationen, Beispiele und andere Details, die der KI helfen, die Aufgabe effektiv zu erledigen (Sollberger, 2025).

In einem nächsten Schritt werden wir uns anschauen, wie Sie einen guten Prompt aufbauen können.

Sollberger, M. (2025). Leitfaden für fortgeschrittenes Prompt Engineering. FOMA.

Grundprinzipien des Prompt Engineerings

Klarheit und Prägnanz

Ein guter Prompt vermeidet ungenaue oder mehrdeutige Formulierungen. LLMs arbeiten rein sprachbasiert – je präziser der Input, desto besser der Output.

Technik: Vage Begriffe wie „irgendwie" oder „etwas" sollen durch konkrete Fachbegriffe oder Fragestellungen ersetzt werden. Ihr Ziel ist es, der KI deutlich zu machen, was genau erklärt oder analysiert werden soll.

Schwach: „Erkläre Stress."

Stark: „Erkläre das transaktionale Stressmodell nach Lazarus und wie es bei Studierenden in Prüfungssituationen angewendet werden kann."

Kontext bereitstellen

LLMs antworten spezifischer, wenn sie instruiert werden, in welcher Rolle sie agieren und welches Ziel sie verfolgen sollen.

Technik: Rolle zuweisen („Du bist ein klinischer Psychologe…") und Ziel nennen („Ziel ist es, Interventionsmöglichkeiten bei Prüfungsangst darzustellen.")

Wo möglich Vorkenntnisse integrieren: „Berücksichtige, dass wir zuvor über kognitive Verzerrungen gesprochen haben."

Beispiel: „Du bist ein klinischer Psychologe. Ziel ist es, Interventionsmöglichkeiten bei Prüfungsangst darzustellen. Berücksichtige, dass wir zuvor über kognitive Verzerrungen gesprochen haben. Nenne konkrete Ansätze, erkläre kurz ihre Wirkweise und gib ein Beispiel aus der Praxis."

Beispiele verwenden

Beispiele helfen dem Modell, Format, Ton und Tiefe Ihrer gewünschten Antwort besser zu erfassen. Zudem verbessert die Verwendung von Beispielen die Qualität der Ausgabe.

Die Beispiele werden auch «Shots» genannt. In gewissen Fällen kann es hilfreich sein, ein solches Beispiel zur Verfügung zu stellen und bei komplexeren Anfragen mehrere.

- Zero-Shot-Prompts: Keine spezifischen Beispiele im Prompt

- One-Shot-Prompts: Ein spezifisches Beispiel im Prompt

- Few-Shot-Prompts: Mehrere spezifische Beispiele im Prompt – hilfreich bei komplexen Fragestellungen, zu denen bereits Ideen oder Daten vorliegen

Shots können beispielsweise folgende Angaben sein:

Formatvorgabe: Geben Sie dem LLM vor, in welcher Struktur die Ausgabe erfolgen soll.

„Stelle die Ergebnisse mit den folgenden Spalten in einer Tabelle dar: Technik, Ziel, psychologischer Wirkmechanismus."

Beispielantwort: Machen Sie dem LLM deutlich, welcher Detaillierungsgrad gewünscht ist.

„Die Vorteile sollten ähnlich strukturiert sein wie: 1. Niedrigschwelliger Zugang, 2. wissenschaftlich fundierte Wirksamkeit, 3. Flexible Integration in den Alltag."

Ausgabeformat spezifizieren

Die Wahl des Ausgabeformats bestimmt, wie die Antwort strukturiert und präsentiert wird. Dies ist besonders entscheidend, wenn die Ergebnisse in formellen Dokumenten wie Berichten oder Präsentationen verwendet werden sollen.

Technik (Beispielhafte Formate):

- Tabelle: „Liste die Daten in einer Tabelle auf: Name, Ziel, Evidenzlage."

- Liste/Aufzählungen: „Erstelle mir eine Liste mit den fünf häufigsten kognitiven Verzerrungen bei Depression, mit je einem Beispiel."

- Code: „Schreib mir einen R-Code, der mir die relativen Häufigkeiten der Geschlechter anzeigt."

Iterative Verfeinerung

Gute Prompts entstehen durch Ausprobieren, Feedback und schrittweises Präzisieren. Geben Sie nicht gleich nach dem ersten Mal auf, verbessern Sie den Prompt Schritt für Schritt.

Beispielhafte Verfeinerung:

- Initialer Prompt: „Erkläre die Wirkung von Achtsamkeit."

- Feedback: „Bitte differenziere die Wirkung von Achtsamkeit mit Blick auf psychische Störungen und nenne ein konkretes Anwendungsbeispiel."

- Feinabstimmung: „Fokussiere dich auf die Wirkung von Achtsamkeit bei Angststörungen und nenne spezifische Therapieprogramme (z. B. MBSR)."

- Weitere Iteration: „Nenne empirische Studien oder Metaanalysen zur Wirksamkeit achtsamkeitsbasierter Interventionen bei generalisierter Angststörung oder sozialer Phobie. Gib auch Informationen zu Stichprobengrösse und Effektstärke an."

- Finaler Prompt: „Erstelle eine tabellarische Übersicht empirischer Metaanalysen seit 2015 zur Wirkung von Achtsamkeit bei Angststörungen, mit Angaben zu Stichprobe, Methode und Effektstärke."

Der Super-Prompt

Der Super-Prompt fasst mehrere Prompt-Techniken in einem strukturierten Ansatz zusammen. Er ist so aufgebaut, dass er das LLM in sechs Schritten durch alle wichtigen Aspekte führt.

- Rolle – Welche Identität nimmt das LLM ein?

„Du bist ein erfahrener klinischer Psychologe, spezialisiert auf kognitive Verhaltenstherapie…" - Aufgabe – Was soll konkret getan werden?

„Erstelle eine tabellarische Übersicht empirischer Metaanalysen seit 2015 zur Wirkung von Achtsamkeit bei Angststörungen, mit Angaben zu Stichprobe, Methode und Effektstärke." - Besonderheiten – Regeln, Emotion, Stil

„Berufe dich auf wissenschaftliche Quellen. Deine Genauigkeit ist von grösster Bedeutung …" - Kontext – Hintergrund der Anfrage

„Diese Analyse ist Teil eines universitären Projekts …" - Beispiele – Beispielanfragen oder -antworten

„Strukturiere deine Antwort wie folgt: 1. Relevanz, 2. Methodik, 3. Ausblick …" - Hinweise – Letzte Tipps & Fallstricke

„Vermeide spekulative Aussagen. Schreibe alle ß als ss."

Die wichtigsten Punkte aus diesem Teil:

- Gute Prompts führen zu besseren Outputs. Es kann manchmal eine Weile dauern, das gewünschte Ergebnis zu erzielen. Es lohnt sich, Verschiedenes auszuprobieren und geduldig zu bleiben.

- Der Super-Prompt deckt mit seinen sechs Bausteinen viele wichtige Komponenten ab und ist ein guter Startpunkt für fortgeschrittenes Prompting.

Teil 3: Effizient Lernen mit LLMs

LLMs können auf unterschiedliche Weise eingesetzt werden. Einerseits ermöglichen sie sogenanntes cognitive offloading: Man lagert Denkprozesse an die Maschine aus, um eine Aufgabe schneller oder einfacher zu erledigen. Das ist praktisch – führt aber oft dazu, dass man sich nicht intensiv mit dem Inhalt auseinandersetzt und dadurch nur wenig lernt. Andererseits lassen sich LLMs gezielt so einsetzen, dass sie das eigene Lernen wirkungsvoll unterstützen.

Bevor Sie ein LLM nutzen, sollten Sie sich deshalb bewusst entscheiden:

- Möchte ich eine Aufgabe einfach nur erledigen oder möchte ich etwas lernen?

Lernziele für diesen Teil:

- Wissen, was erfolgreiches Lernen ausmacht

- Den sokratischen Tutor als Lernunterstützung kennen

Was macht erfolgreiches Lernen aus?

Effizientes vs. Ineffizientes Lernen

Effiziente Lernstrategien zeichnen sich durch die aktive Beteiligung am Lernprozess aus. Lernende tun mehr, als Informationen nur passiv aufzunehmen: Indem sie Fragen stellen, diskutieren, zusammenfassen oder Aufgaben lösen, setzen sie sich aktiv mit dem Lernstoff auseinander. Zahlreiche Studien belegen, dass solche aktiven Methoden dem passiven Lernen deutlich überlegen sind (Ambrose et al. 2010; Ang, 2021; Freeman et al., 2014; Hartikainen et al., 2019; Michael, 2006).

Ineffizientes Lernen zeichnet sich durch Passivität aus. Informationen werden lediglich oberflächlich aufgenommen und kaum aktiv verarbeitet. Typische Beispiele sind rein rezeptives Zuhören während Vorlesungen oder oberflächliches Lesen von Texten, ohne diese kritisch zu reflektieren oder tiefergehend zu hinterfragen. Auch kurzfristiges Lernen, oftmals unmittelbar vor Prüfungen („Cramming"), gehört dazu: Obwohl intensives Lernen in letzter Minute kurzfristige Erfolge ermöglichen kann, fördert es kaum ein langfristiges Verständnis (McIntyre & Munson, 2008). Darüber hinaus bleiben bei ineffizienten Lernmethoden häufig wichtige Wissenslücken unerkannt oder werden bewusst ignoriert, da es an regelmässigem und konstruktivem Feedback fehlt.

Ein weiterer wichtiger Faktor für erfolgreiches Lernen ist die Motivation: Lernende, die den Stoff nur widerwillig oder ausschliesslich aufgrund externer Vorgaben wie Prüfungsdruck erarbeiten, investieren oft nur wenig in aktives, vertiefendes Lernen. Dies führt dazu, dass das erworbene Wissen nicht nachhaltig im Gedächtnis verankert wird.

Studien weisen darauf hin, dass aktives Lernen zu besseren Lernergebnissen führt als passives Lernen. Aktives Lernen „funktioniert" demnach besser, weil es die tiefe Verarbeitung fördert und das Wissen flexibler anwendbar macht.

Alltagsbeispiele:

Effizient: Eine Studentin wiederholt während des Lernens zentrale Begriffe in eigenen Worten, diskutiert in einer Lerngruppe und wendet Theorien auf Alltagsbeispiele an. Sie nutzt zur Kontrolle Quizfragen und bittet eine Kommilitonin um Feedback zu einer Zusammenfassung. Dadurch bleibt sie engagiert und erkennt sofort, was sie noch nicht verstanden hat.

Ineffizient: Eine Studentin liest das Skript mehrfach passiv durch, ohne sich Notizen zu machen oder über den Inhalt nachzudenken. Sie beginnt erst am Abend vor der Klausur mit dem Lernen („cramming"). Sie erhält kein Feedback und prüft auch nicht ihr Verständnis. In der Prüfung kann sie einige Fakten reproduzieren, vergisst aber vieles kurz danach wieder.

Zu Beginn der Schulung haben Sie gesehen, dass der Umgang mit einem LLM kritisches und aktives Denken erfordert. LLMs sind keine Wahrheitsmaschinen. Ihre Antworten müssen immer auf Plausibilität geprüft und mit dem eigenen Wissen abgeglichen werden. Es ist wichtig, unsichere oder unklare Aussagen zu erkennen und überall dort, wo Sie selbst nicht sicher sind, ob etwas korrekt ist, sollten Sie gezielt nachprüfen. Nehmen Sie zum Beispiel Fachliteratur oder vertrauenswürdige Quellen zur Hilfe.

Diese kritische Auseinandersetzung mit Inhalten entspricht genau dem, was Forschung als besonders effektiv für nachhaltiges Lernen beschreibt. Wenn Sie ein LLM also bewusst und reflektiert nutzen, entsteht dadurch eher ein Lerneffekt.

Ambrose, S. A., Bridges, M. W., DiPietro, M., Lovett, M. C., & Norman, M. K. (2010). How learning works: Seven research-based principles for smart teaching. John Wiley & Sons.

Ang, K. C., Afzal, F., & Crawford, L. H. (2021). Transitioning from passive to active learning: Preparing future project leaders. Project Leadership and Society, 2, 100016.

Freeman, S., et al. (2014). Active learning increases student performance in science, engineering, and mathematics. PNAS, 111(23), 8410–8415.

Hartikainen, S., et al. (2019). The concept of active learning and the measurement of learning outcomes. Education Sciences, 9(4), 276.

McIntyre, S. H., & Munson, J. M. (2008). Exploring cramming. Journal of Marketing Education, 30(3), 226–243.

Michael, J. (2006). Where's the evidence that active learning works? Advances in physiology education.

Der sokratische Tutor

Ein LLM kann so instruiert werden, dass es sich wie ein sokratischer Tutor verhält. Ein sokratischer Tutor fördert durch gezielte, offene Fragen das selbstständige und kritische Denken. Der Tutor gibt keine direkten Antworten, sondern hilft den Lernenden, eigene Antworten zu entwickeln und ihr Verständnis zu vertiefen (Mahoney et al., 2023). Diese Methode fördert aktives Lernen und höhere kognitive Fähigkeiten wie Analyse und Reflexion (Fakour, 2025).

In dieser Sitzung werden Sie mit einem LLM-gestützten sokratischen Tutor interagieren. Der Tutor stellt Fragen und gibt Hinweise, doch Sie sollen selbst die richtigen Antworten finden. Die Lernziele werden Ihnen zur Verfügung gestellt, sodass Sie Ihren Fortschritt überwachen können.

Allgemeine Tipps im Umgang mit LLM-gestützten Chatbots:

- Aus den vorangegangenen Teilen wissen Sie, dass LLMs nicht darauf ausgelegt sind, wahre Aussagen zu garantieren. Hinterfragen Sie die Outputs also kritisch. Wenn Ihnen eine Antwort des Tutors fragwürdig erscheint oder Sie selbst etwas nicht wissen: Überlegen Sie zunächst gründlich, identifizieren Sie gezielt das Problem, und recherchieren Sie fehlende Konzepte (z. B. online oder in Unterlagen).

- Schildern Sie Ihren Denkprozess so transparent wie möglich im Chat – auch wenn Sie externe Quellen verwendet haben. Erklären Sie dem Tutor, wie Sie bei der Bearbeitung der Aufgaben vorgegangen sind: Was haben Sie verstanden? Welche Überlegungen haben Sie angestellt? Wo sind Sie auf Schwierigkeiten gestossen oder nicht weitergekommen? Je nachvollziehbarer Sie Ihren Lösungsweg beschreiben, desto gezielter kann der Tutor auf Ihre individuellen Fragen und Herausforderungen eingehen.

- Behalten Sie die Lernziele im Auge und überwachen Sie, ob der Tutor entsprechend vorgeht.

Fakour, H., & Imani, M. (2025). Socratic wisdom in the age of AI. Frontiers in Education, 10, 1528603.

Mahoney, B. B., et al. (2023). Learning to think critically through Socratic dialogue. Thinking Skills and Creativity, 50, 101422.

Die wichtigsten Punkte aus diesem Teil:

- Aktives Lernen (Fragen, Diskutieren, Anwenden) ist effektiver als passives Lernen.

- Ein LLM kann die Rolle eines sokratischen Tutors annehmen und Lernende durch gezielte Fragen zum Nachdenken anregen, statt direkte Lösungen zu liefern.

Herzlichen Glückwunsch – Sie haben die Schulung erfolgreich abgeschlossen!

Im nächsten Schritt können Sie mit dem LLM-gestützten Tutor interagieren, um Ihr Wissen zu Regressionsanalysen aufzufrischen. Wenn Sie sich weiter mit den Inhalten der Schulung beschäftigen möchten, finden Sie unten ergänzende Materialien.